El presupuesto de rastreo

El Crawl Budget (presupuesto de rastreo) puede afectar a la indexación, al posicionamiento e incluso comerse la renderización de tu web

- Autor:

-

Carlos Sánchez

- Temática:

- Enlazado ,

- Multimedia ,

- Rastreo ,

- Renderizado ,

- Tecnologías ,

- WPO

- Fecha de publicación:

- 2025-12-05

- Última revisión:

- 2026-04-15

Nota: En mi empresa me he llegado a encontrar proyectos grandes que tenían graves problemas de rastreo que estaban disfrazados como problemas de renderizado.

Hoy os voy a mostrar como detectar esto y posibles estrategias de solución. Pero antes de llegar a ello, vamos a definir el Crawl Budget, ya que es bastante importante tener todos estos conceptos claros. Ya verás que majo este artículo que me ha quedado sobre el presupuesto de rastreo.

El Crawl Budget o presupuesto de rastreo es la cantidad de recursos (tiempo, peticiones y capacidad de procesamiento) que Google está dispuesto a dedicar a rastrear un sitio web en un periodo determinado.

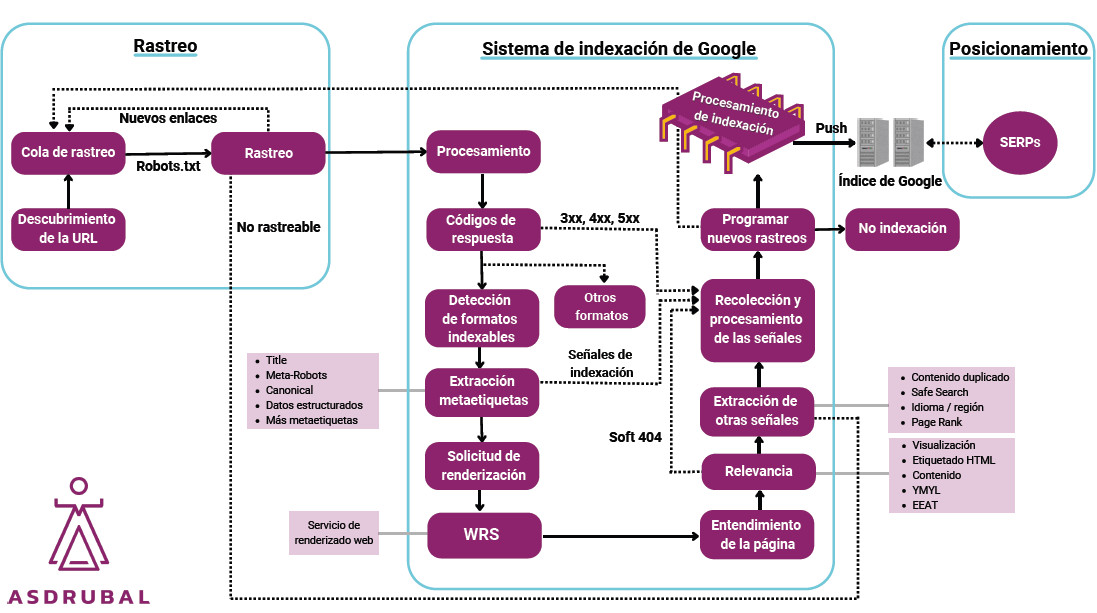

Se compone de dos factores principales:

- Límite de capacidad de rastreo: Cuántas peticiones simultáneas puede hacer Googlebot sin sobrecargar tu servidor y a qué velocidad puede hacerlo dependiendo también de sus propios recursos.

- Demanda de rastreo: El interés que tiene Google en rastrear tu sitio, basado en la cantidad de URLs, la popularidad de tus URLs, la frecuencia con que cambia tu contenido y la importancia que le atribuye a tus páginas.

Dicho de una forma más simplificada, una vez que Google destina un tiempo a tu página web (que varía con el tiempo), cuántos recurso de tu web le da tiempo a rastrear.

Por ejemplo, Google le destina una mayor cantidad de tiempo a Wikipedia que a mi web, la con mayor frecuencia y le dedica más tiempo. También es cierto que Wikipedia tiene mucha más información y actualiza con mayor frecuencia.

La mayor parte de webs no tienen problema y Google suele ser bastante preciso. No obstante tu web puede no formar parte de esa mayoría de páginas.

Detectar si tengo un Crawl Budget bajo

Si el 80% de lo que rastrea Google en tu web es irrelevante, por mucha calidad que tenga el 20% restante, tu web en su mayoría es irrelevante.

Desafortunadamente Google no te informa de una forma tan directa si tienes problemas de presupuesto de rastreo, no obstante si que hay pequeñas pistas que te pueden dar a entender que Google no es capaz de rastrear la web, además de lo que puede tardar en indexarse una página nueva, veamos síntomas posibles.

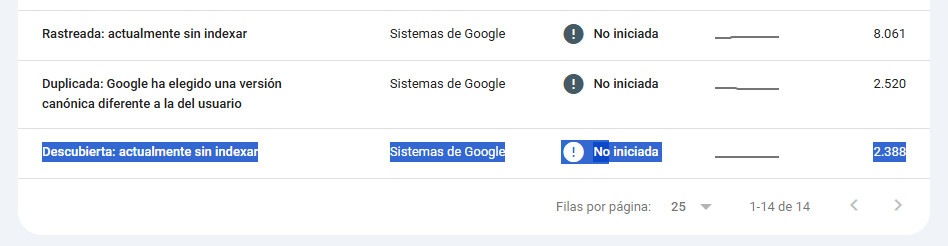

Descubierta: Actualmente sin indexar

En tu Search Console, ve al panel izquierdo donde pone Indexación > Páginas. En dicho lugar te dirán motivos por los que tus páginas no se indexan. Esto no es siempre negativo, es meramente informativo, nosotros como SEOs debemos saber diferenciar esos mensajes y cuándo debemos actuar.

En el caso de que te salga un mensaje así efectivamente es el momento de actuar, y te aseguro que el problema es una falta de presupuesto de rastreo:

Este es un mensaje parecido al de "Rastreada: actualmente sin indexar", pero eso quiere decir que claramente hay una cantidad de páginas que Google no ha rastreado. A Google que le encanta rastrear todo lo que se encuentra.

Análisis de Logs

Si Googlebot no aparece en tu web con la frecuencia que debería, evidentemente tienes un problema de rastreo.

Otro error

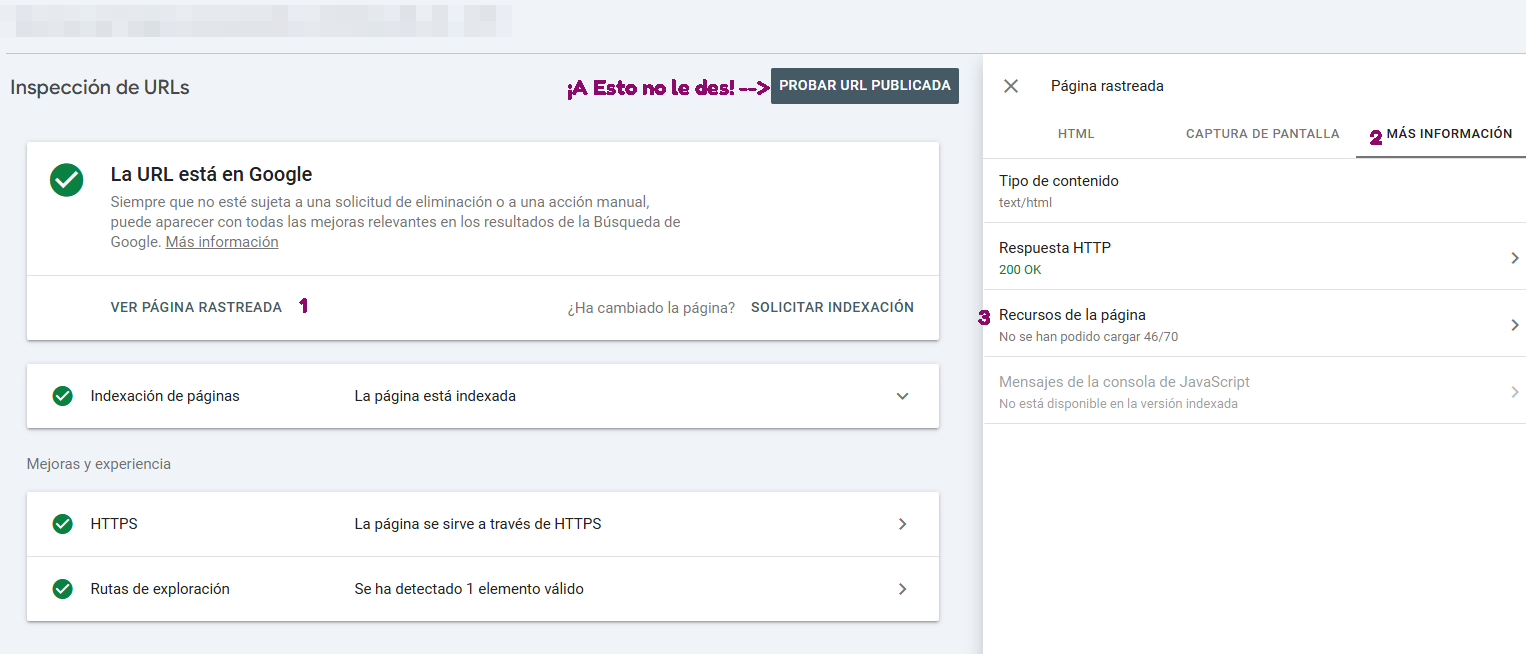

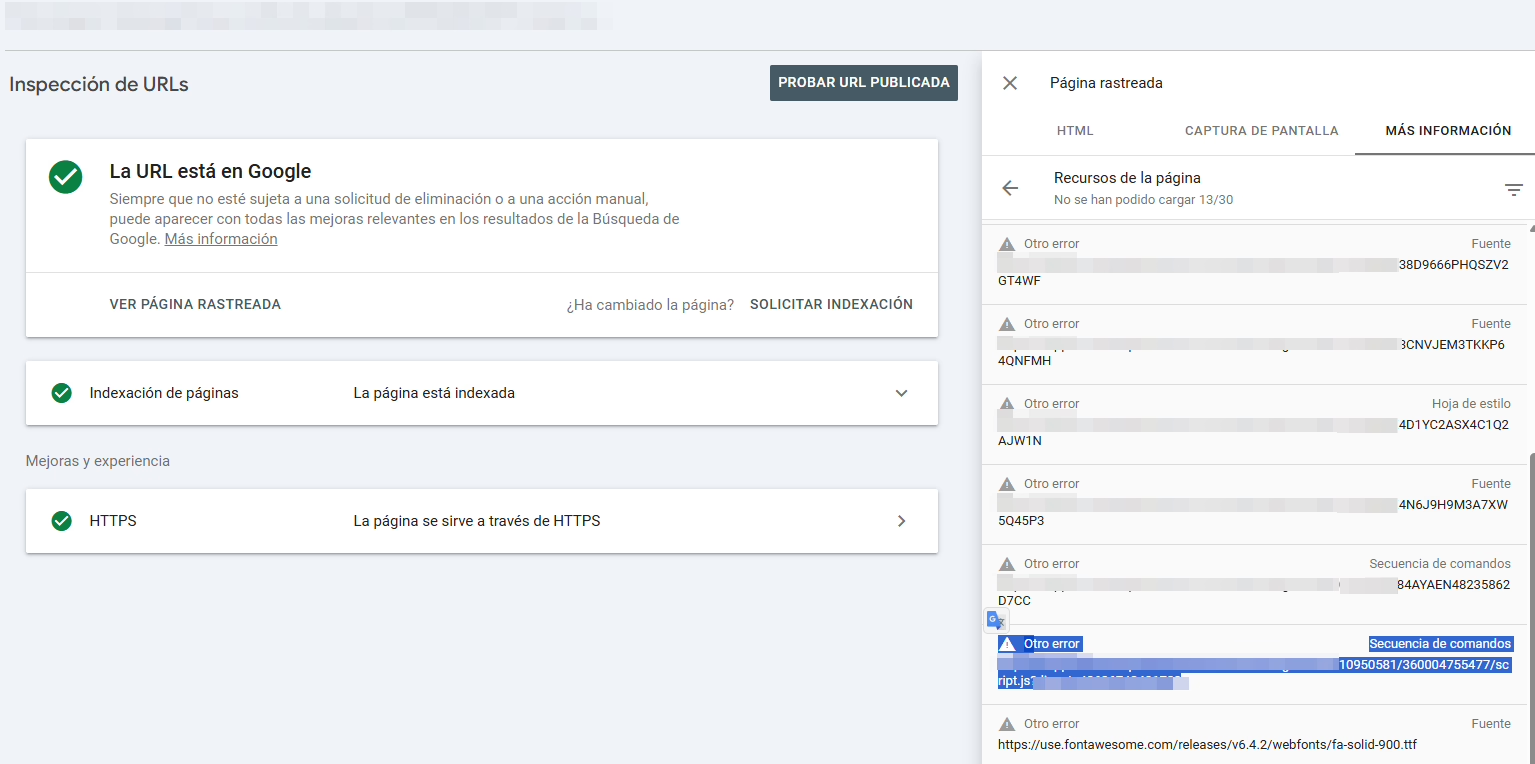

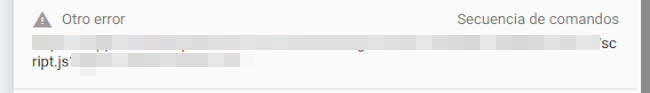

Existe una forma no oficial de detección de errores de presupuesto de rastreo y se puede ver al inspeccionar con Google Search Console una URL indexada.

Para ello debes acceder a Recursos de la página, te adjunto en la imagen como debes hacerlo:

- Le das a ver página rastreada

- Seleccionas en el panel de la derecha la pestaña de "más información"

- Ahí tienes que hacer click en "Recursos de la página"

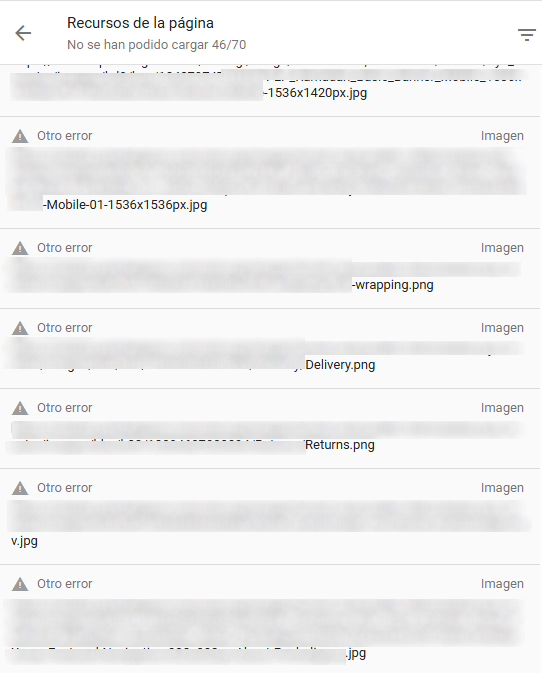

Cualquier otro motivo (robots.txt o códigos de respuesta) te son indiferentes para el Crawl Budget, también descarta los recursos que no son de tu dominio (en principio a menos que sean vitales para tu contenido)

¿Cuándo preocuparse?

Cuando te aparezca el famoso mensaje de "Otro error" y sea de tu dominio o tu CDN. En esos casos amigo, tienes problemas de Crawl Budget y es posible que las imágenes, JS, o CSS de tu web no se vea. Analiza como de importante son esos recursos que no se han podido obtener.

¿Por qué se puede producir un crawl budget bajo?

Suele afectar a proyectos que tengan:

- Webs de más de 1 millón de páginas con contenido que cambie aproximadamente una vez a la semana.

- Webs con más de 10.000 páginas cuyo contenido cambia a diario.

Eso al menos dice como referencia la guía de Google, pero aunque a priori podamos pensar que no estamos en dicha lista puede ocurrir por motivos como:

- Una web excesivamente lenta.

- Bucles mal gestionados por culpa de URLs relativas mal diseñadas.

- Webs con duplicados como versiones de www y no www, o slash y similares.

- Webs con múltiples idiomas que solo multiplican la cantidad de páginas y no aportan valor.

- Webs con elementos descargables excesivamente pesados (más aún si son únicos por cada página).

- Webs medianas o grandes con mala gestión de sus sitemaps.

- Servidor poco potente que arroja un 429 cuando hay un mínimo rastreo.

- Gran cantidad de páginas soft 404 que hacen que Google no tenga interés en seguir rastreando la página (esto puede ocurrir por muchos motivos).

Problemas que ocasiona un Crawl Budget bajo

Tener un Crawl Budget bajo, aunque infrecuente especialmente en proyectos pequeños, no es un problema menor. Ya que principalmente puede evitar la indexación de páginas, si no hay indexación evidentemente no hay posicionamiento.

Desindexación masiva

Es posible que si Google empieza a considerar irrelevante tu web y reduce el rastreo se te acaben desindexando contenidos.

Lentitud a la hora de indexar

Si tienes un Crawl Budget tendrás una gran lentitud a la hora de indexar contenido, por más que le des a Inspeccionar URL en la Search Console, uses el todopoderoso API Indexing o lo pongas en tus sitemaps.

Problemas de renderizado

Como lo oyes, si ves el gráfico mostrado arriba, la renderización va después del rastreo. Es posible que aunque una página haya pasado el filtro de rastreo todos los archivos no. Hay en ocasiones en las que el archivo de JavaScript es dinámico, si este es el caso, te enfrentas al grave problema de que Google no renderice correctamente tu web al faltarle JS Critico, por lo que se convierta en una pescadilla que se muerde la cola y hacer que tu contenido de calidad se considere como thin content (porque le falta información que le tuvo que haber llegado)

Si cuando inspeccionas páginas indexadas sin darle a probar URL (esto es muy importante, porque no es lo mismo comprobar en tiempo real que hizo realmente Google). ves el mensaje "Otro error" es posible que se deba a un problema de presupuesto de rastreo que está impidiendo que Google rastree los recursos.

En ocasiones puede ser irrelevante, pero puede cargarse un proyecto si lo que no es capaz de rastrear son JS únicos por página que generan contenido dinámico esencial por web, haciendo que en webs grandes sea una cantidad exorbitada que Google no es capaz de procesar.

En estos casos es posible que Google rastree la página pero no vea el contenido que debería ver. Un problema silencioso que puede matar webs enormes.

En este caso hay que tomar decisiones drásticas y posiblemente arriesgadas, pero menos que dejar que la web se consuma sola a ojos de Google.

Frameworks donde suele ocurrir esto:

Los SEOs solemos defender a capa y espada el SSR cuando se trata de Frameworks de JS y su renderizado, se nos llena la boca con sus ventajas y también sobre la rehidratación por la velocidad. Pero estos son los fallos más típicos:

¡Click para ver este contenido avanzado!

Next.js

Especialmente cuando se usa:

- SSR con datos dinámicos

- Middleware que cambia el contenido según la URL

- Route Handlers o API Routes que generan bundles per-route

- Dynamic Imports

Entonces se produce un JS distinto para cada página, a veces con hashing distinto por request (a la mierda nuestro presupuesto).

En modo SSR/ISR con hydration: Genera chunks de JS únicos por ruta, especialmente con getServerSideProps. Cada página puede tener su propio bundle dinámico.

Nuxt.js

Nuxt genera:

- Un client bundle general

- Pero también chunks por página, y si usas datos dinámicos puede regenerarlos constantemente.

Si usas server middleware, nuxt generate, nitro, etc., puedes retornar assets con expiraciones bajas.

Por ejemplo: Los payloads de hidratación (_payload.js) son únicos por página.

Angular Universal

Genera bundles de hidratación bastante pesados y, dependiendo de lo creativo (o imprudente) que sea el programador, puede acabar produciendo bundles únicos por página.

SvelteKit

Genera módulos JS específicos por ruta con hashes dinámicos.

Gatsby (durante builds frecuentes o ISR)

Aunque es SSG, Gatsby:

- Inserta hash dinámico en cada build

- Cambia los chunks incluso si solo cambia una línea en cualquier parte

Si se publica con mucha frecuencia → Google prueba a renderizar y el JS ya no coincide.

Todos estos Frameworks siguen siendo válidos para SEO, pero siempre deberían estar supervisados por un equipo de SEOs profesionales, especialmente si el proyecto es importante.

Como mejorar el Crawl Budget

Advertencia: El Crawl Budget no es un ranking factor de forma directa, es decir, si tienes una página indexada no mejorará su posicionamiento. Pero si puede favorecer la indexación de páginas si lo que ocurre es que parte de tu web no aparece ni en Google.

Dicho eso, si el Crawl Budget impide el rastreo de ciertos archivos cruciales de JS pueden afectar al renderizado que SÍ afectarán al posicionamiento.

Una vez que hemos detectado este problema puede haber casi tantas causas específicas como webs en el mundo, así que aquí tienes un listado de posibles motivos de tener un mal presupuesto de rastreo:

- Si tu web es lenta afectará al Crawl Budget, el Crawl Budget es básicamente el tiempo que los bots le pueden dedicar a tu web, por lo que si pueden rastrear más contenido en menos tiempo, puede mejorar considerablemente tu crawl budget, especialmente en webs con una gran cantidad de páginas (como referencia más de 10.000 páginas con contenido que actualiza periódicamente o más de 1 millón de páginas con contenido que actualiza más lento). Prácticas concretas de WPO que podemos hacer hay más de las que te podría contar en toda mi vida.

- Limitación de páginas irrelevantes: Google rastrea todas las páginas, diferentes versiones (con m. o incluso amp), todo tipo de parámetros. Si ves que Google rastrea una gran cantidad de páginas que pueden ser irrelevantes (Como ocurre con el caso de Shopify con el /search por defecto en las webs internacionales) es posible que tu presupuesto de rastreo se vea afectado.

- Frecuencia de actualización: Google va ajustando el presupuesto de rastreo, y si bien es cierto que no le gustan las "actualizaciones artificiales" que no aportan valor, es posible que un cambio radical pille a Google sin poder rastrear todo el cambio de contenido de golpe.

- El enlazado interno importa: Aunque no siempre a de ser así, si la home de tu web es la página más importante, las páginas enlazadas a ellas por lo pronto también Google las considerará importante. Si haces algún cambio que crees que Google debería tener en cuenta o tienes una página prioritaria con el clásico mensaje en Search Console de "Descubierta: actualmente sin indexar". Un enlazado interno bien planificado siempre le hará bien a tu web.

- Los enlaces desde un Sitemap son interesantes: No solo te permitirán revisar en Search Console de forma más específica la indexación e impresiones de las agrupaciones de páginas que hagas en el Sitemap. Sino que el sitemap de noticias y el lastmod te pueden ayudar enormemente, o mejor dicho, ayudará a Google a ayudarte.

- El disallow del robots.txt, los 4XX y los noindex son medidas eficaces para evitar el rastreo en páginas irrelevantes, especialmente irrelevantes de cara a Google. Úsalas en concordancia con las necesidades y lo que te aportan dichas páginas.

- Evita rastreos infinitos: Search Console, Ahrefs, Screaming Frog, Bing Webmaster, SE Ranking, Sitebulb entre otras son herramientas eficaces para detectar bucles infinitos o páginas irrelevantes. Úsalas con cabeza.

- Utilización del Código de respuesta 304: Es arriesgado, pero en ocasiones es necesario tomar decisiones drásticas, puedes generar un 304 para contenido útil que lleve tiempo sin actualizar de cara a Google (que los usuarios lo sigan viendo normalmente) y Google se pueda centrar en el contenido nuevo. Google utilizará el último contenido rastreado y ahorrará tiempo y recursos del servidor y de Google, mejorando la eficiencia de rastreo.

Consejo: Si estás ante una web muy grande que actualiza relativamente poco y te vas a enfrentar a una actualización masiva, por ejemplo una migración, puedes considerar hacerlo por partes para que Google tome mejor el cambio. (Algo que con sitios pequeños o que actualizan con mucha frecuencia nunca va a ser problema.

Más consejos interesantes

- El Crawl-delay es inútil: Es tanto el tiempo que veo perdido en esto, que veo relevante añadirlo aquí, no mejorará tu crawl budget el no ponerlo, pero te permitirá no perder el tiempo con esto y buscar cualquiera de las otras soluciones que te he planteado.

- El nofollow lo carga el diablo: Google puede descubrir la página de otras formas distinto a esa directiva de nofollow, de hecho lo hará. No lo uses como forma eficaz de apuntalar el presupuesto de rastreo, no es eficaz y no es escalable.

- El noindex es una medida para hacer que Google rastree una página con menos frecuencia, sin embargo es menos eficaz que un disallow o los códigos de respuesta 4xx (menos 429), esto se debe a que con los códigos de respuesta Google directamente no pasará por la página a rastrearlo, sin embargo para obtener el noindex, Google debe rastrear la página. Por lo que el noindex es una medida para evitar el rastreo, pero hay otras medidas más directas y radicales. (Con un 5xx durante al menos un mes Google seguirá rastreando con la misma frecuencia)

- Las imágenes decorativas son prescindibles para Google. Si está muy mal la cosa o las imágenes decorativas pesan excesivamente podemos ahorrarle la descarga del multimedia especialmente pesado a Google.

Es importante también saber detectar con honestidad si el problema de Crawl Budget se debe a que Google no está utilizando una cantidad de recursos suficientes para rastrear tu contenido de calidad o si es un cuestión de que un alto porcentaje de tu web es tan irrelevante que le haces difícil a Google la tarea de rastrear tu web.

Evita alarmarte

Las estrategias para evitar problemas con el Crawl Budget siempre tienen un riesgo y deben ir acompañadas de un profesional durante todo el proceso.

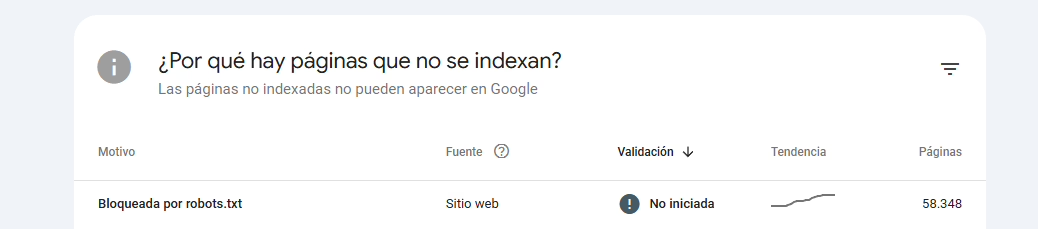

Si aplicas soluciones como un Disallow a todo el contenido irrelevante de tu web es posible que en la Search Console te aparezca algo así:

Que no se indexen es buen síntoma, que no se rastreen aún más, Google podrá concentrarse ahora en las páginas relevantes.

Bibliografía

- Guía oficial de Google de presupuesto de rastreo.

- Experiencia con Logs en todo tipo de proyectos, tanto grandes como pequeños.

Te falta mi máster. Accede a una formación avanzada que te permitirá aplicar e implementar SEO en cualquier tipo de WEB

¡Accede al Máster de SEO Técnico!